AI Agent 很强,但它会“越跑越偏”

最近一段时间,AI Agent 被描述为“可以接管一切”的存在。

写代码、跑项目、自动执行复杂流程,甚至有人认为它已经可以替代工程师。

但在实际使用之后,我的感受恰恰相反:

Agent 很强,但它的边界,同样非常清晰。

一、上下文窗口 ≠ 记忆

很多人会提到:

“现在模型已经支持 200k 上下文,甚至更高”

但这其实是一个误解。

上下文窗口,只是当前推理时可见的信息范围,

而不是“记忆”。

当信息超出当前窗口:

- 要么被丢弃

- 要么被压缩

- 要么被检索拼接

无论哪种方式,本质都是:

重建,而不是持有。

二、中断,不是修正,而是重构

在使用 Agent 时,我发现一个非常关键的问题:

👉 它无法被中途稳定纠正。

当你发现它执行方向有偏差时,你只能:

- 让它继续执行

- 或者中断,然后补充信息

但问题在于:

中断之后,它会重新理解整个上下文。

这意味着:

- 新信息加入

- 语义权重重新分布

- 原本正确的部分,也可能被重新解释

最终结果是:

你不是在修正一个系统,而是在“重建一个系统”。

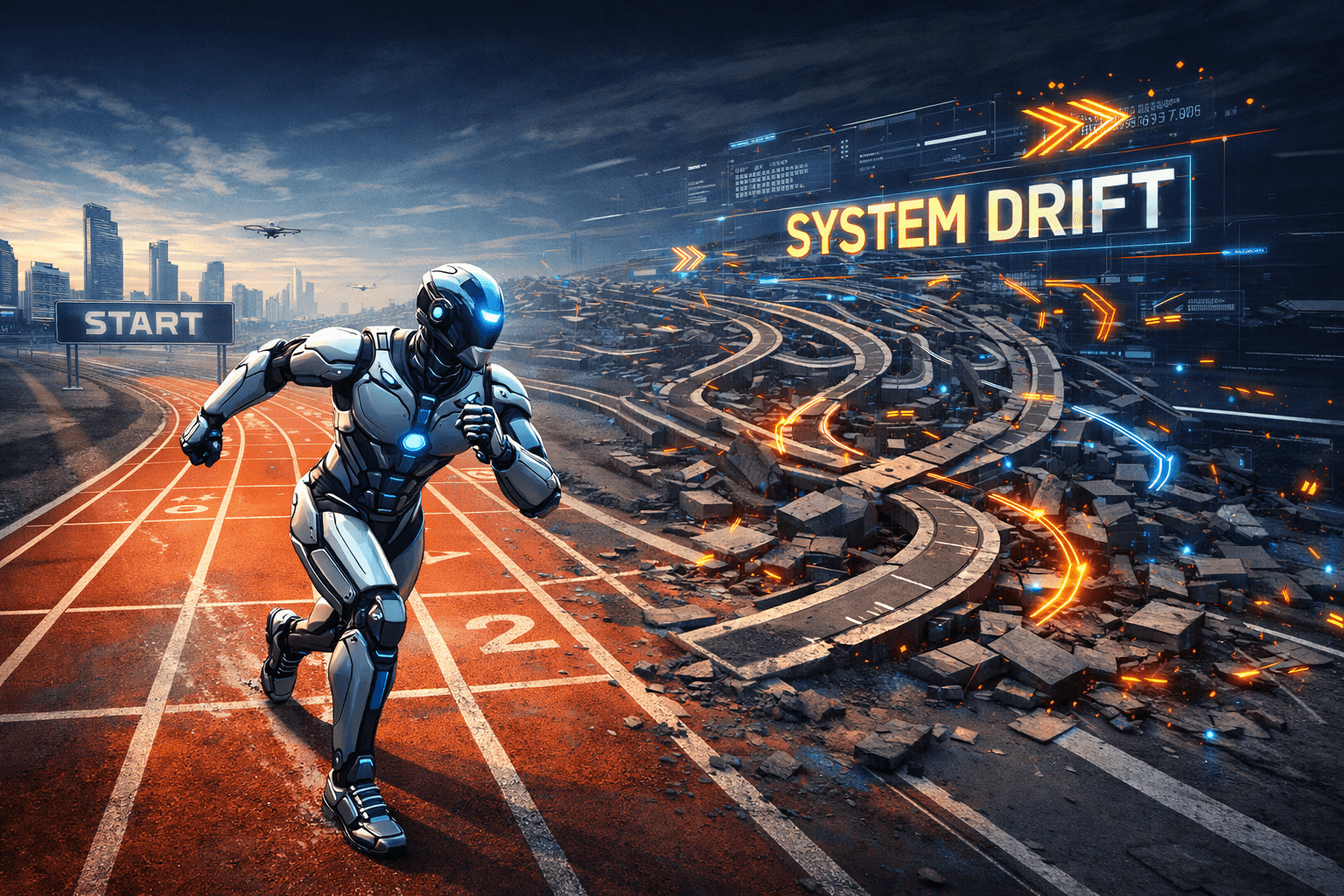

三、流程越长,漂移越严重

Agent 在短任务中表现很好,但在长流程中会出现一个明显现象:

语义漂移(drift)

表现为:

- 初期步骤是正确的

- 中期开始出现轻微偏差

- 后期逐渐偏离原目标

- 最终进入循环或无效执行

如果你让一个 Agent 持续运行数小时甚至更长时间,

你会发现:

它消耗了大量 tokens,但结果并没有收敛。

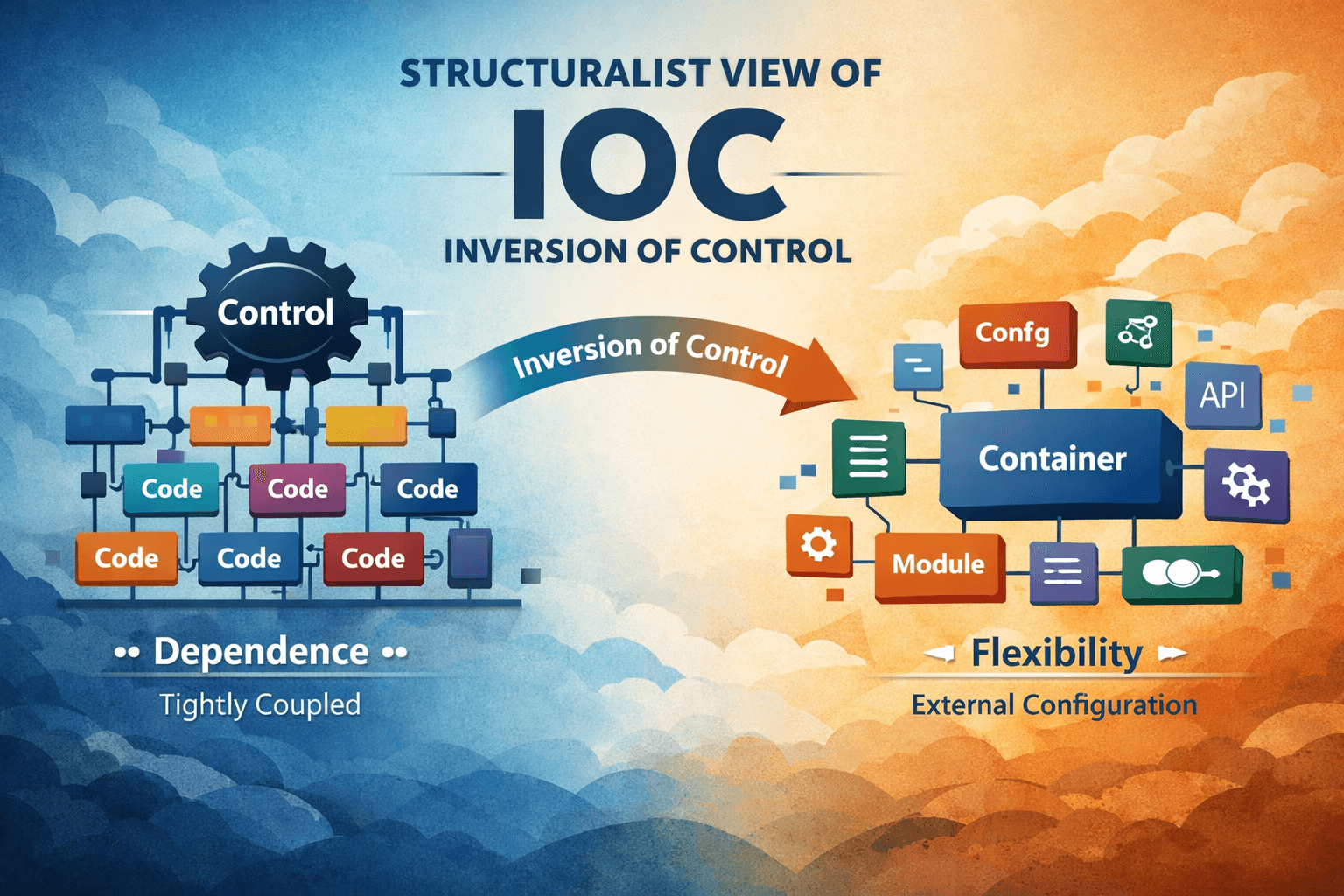

四、问题的本质:结构无法持久化

这些问题的根源,并不是“模型不够聪明”,而是:

结构无法被稳定承载。

当前 Agent 的“记忆”本质上是:

- 检索

- 拼接

- 临时上下文

而不是:

- 不变量

- 约束系统

- 演化结构

五、为什么这很重要?

因为复杂系统的本质不是“完成任务”,而是:

在变化中保持结构稳定。

一个系统可以允许局部错误,

但不能失去结构一致性。

六、结论

所以一个更现实的判断是:

- Agent 很适合任务

- 但不适合系统

除非有一天,AI 可以做到:

结构本身被持久化,而不是依赖人类维护

否则:

工程的结构主权,仍然在人类手中。

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 观澈辨机!